工具说明

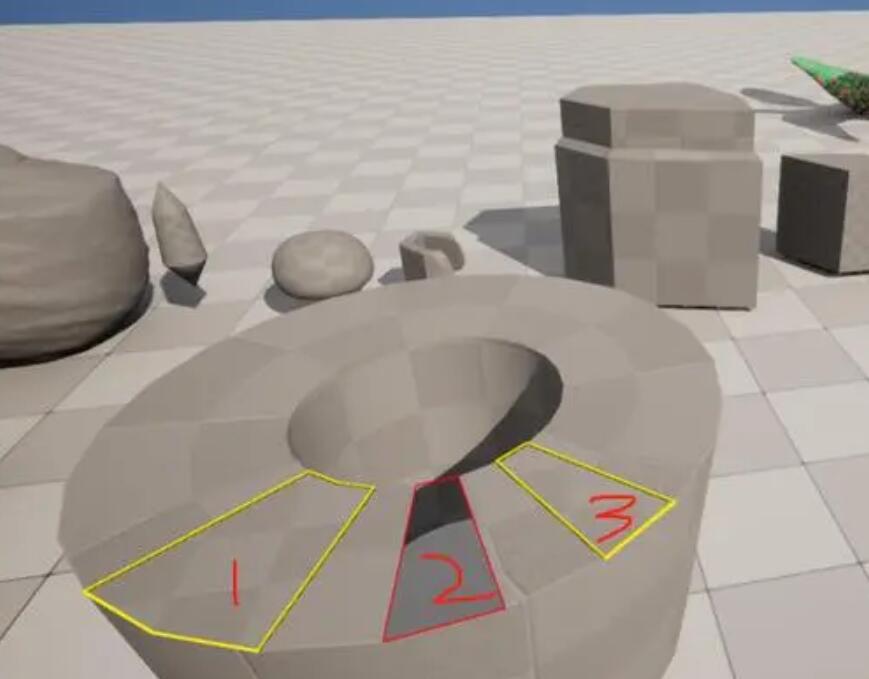

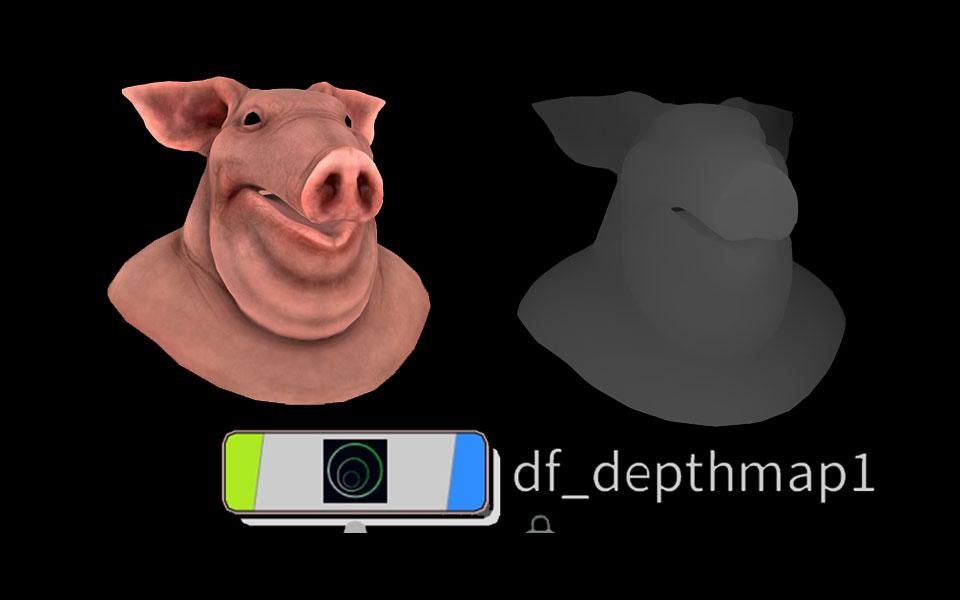

该工具可以通过Houdini场景生成的深度图制作最终的flux 渲染效果,支持gguf和fp8两种深度出图Flux模型。生成的图片可以自动返回到Houdini工程里。

![图片[1]-Flux Depth生图工作流-数字折叠](https://oss.digitfold.com/img/2025/03/20250330003324206.jpg)

![图片[2]-Flux Depth生图工作流-数字折叠](https://oss.digitfold.com/img/2025/03/20250330003331784.jpg)

![图片[3]-Flux Depth生图工作流-数字折叠](https://oss.digitfold.com/img/2025/03/20250330003338313.jpg)

使用方法

1.首先使用深度出图工具将模型depth图片渲染输出

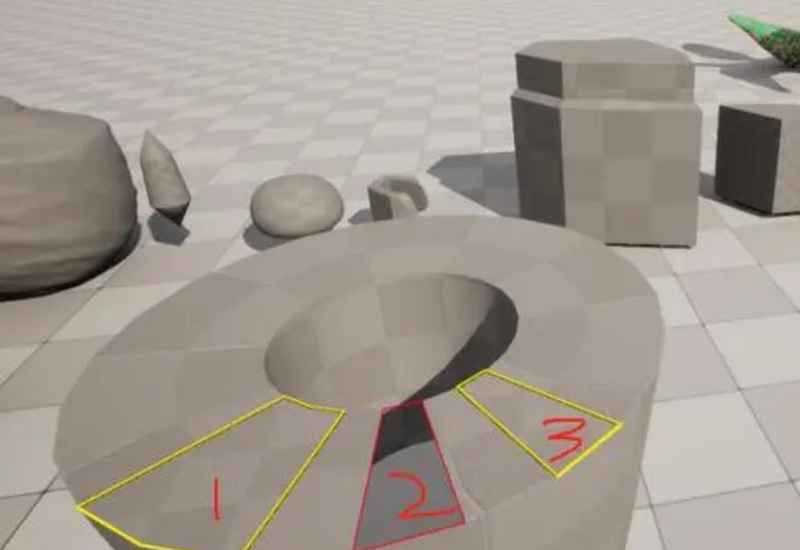

2.新建一个geo节点,在里面创建df flux dpcon工具,写好提示词,配置好模型数据,将刚刚生成的深度图路径填写到深度图路径选项里。点击启动ComfyUI和执行命令生图。

3.生图完成后打开Composite View窗口查看图片。

节点名

DF_Flux_dpcon

![图片[4]-Flux Depth生图工作流-数字折叠](https://oss.digitfold.com/img/2025/03/20250330021445455.jpg)

环境配置

Houdini配置

Houdini需要先先安装WebSocket Python模块,安装方法:在Houdini Python中安装WebSocket模块-数字折叠

ComfyUI插件

- GGUF:ComfyUI-GGUF插件下载-数字折叠

- Inspire Pack:ComfyUI-Inspire-Pack 扩展节点插件-数字折叠

- UltimateSDUpscale:ComfyUI_UltimateSDUpscale高清放大插件-数字折叠

- Easy_Use:ComfyUI-Easy-Use自定义节点集成包插件-数字折叠

- Crystools:ComfyUI Crystools 可视化实时显示硬件性能-数字折叠

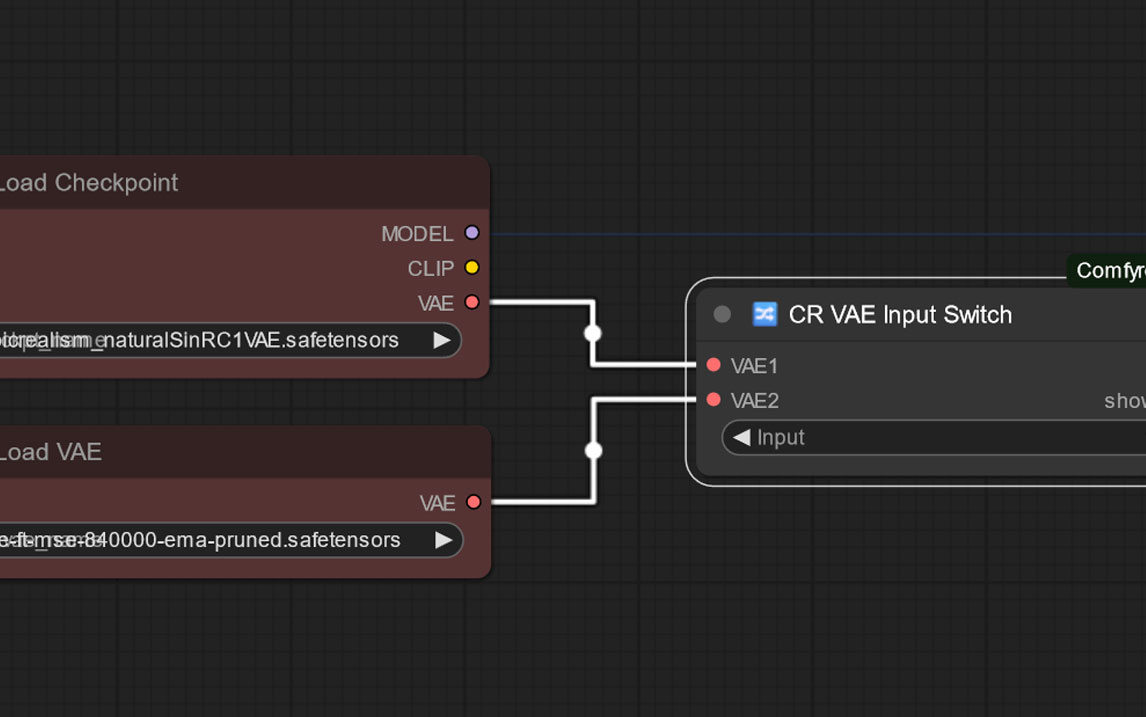

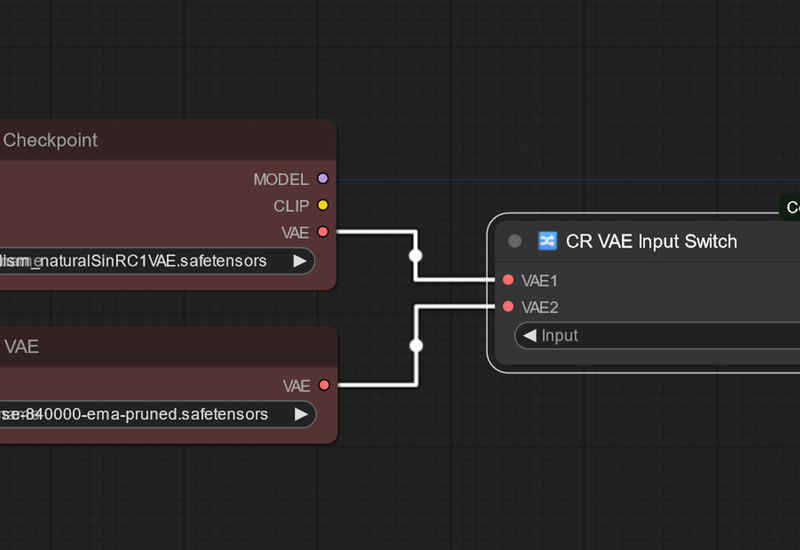

ComfyUI模型配置

- Flux depth模型:Flux1.0原生depth深度图控制模型fp8和gguf版本-数字折叠

- 高清放大模型::4x-ClearRealityV1-4x-UltraSharp细节增强模型-数字折叠

参数说明

- 启动AI:点击后会启动ComfyUI程序,需要先配置好ComfyUI的路径

- 执行:点击后就会执行出图操作,执行完会将图片导入到hda里面的Copnetwork节点,需要打开Composite View面板查看

- 种子:不同种子会得到不同的图像

- 提示词:写出图的提示词,需要加上LoRA的触发词,细节建议用Chatgpt添加

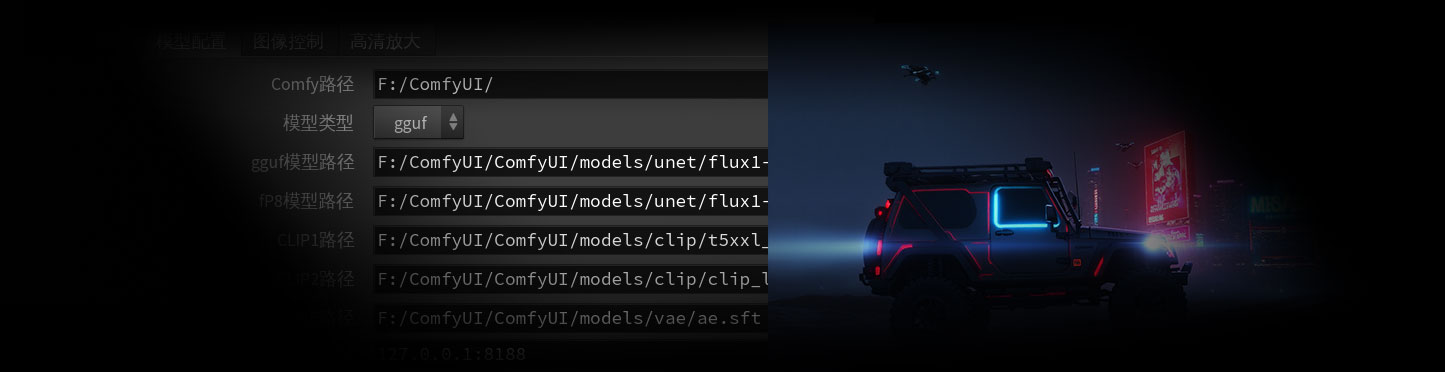

模型配置

- Comfy路径:填写你的ComfyUI安装目录

- 模型类型:gguf出图时间会更快一些,fp8模型质量可能会更好一些,但是需要一定的加载时间,默认使用gguf.

- gguf路径:选择/models/unet路径下的gguf模型,可从上面提供的下载文章里下载。

- fp8路径:选择/models/unet路径下的fp8模型,可从上面提供的下载文章里下载,就算选择gguf模型模式fp8模型路径也要填写一个模型的名称。因为ComfyUI会一次性读取所有节点,所以要保证每个节点都有正确的配置。

- Clip1路径:选择models/clip/下的t5xxl_fp8_e4m3fn.safetensors,可在上面Flux depth模型下载链接里获取。

- Clip2路径:选择models/clip/下的clip_l.safetensors,可在上面Flux depth模型下载链接里获取。

- VAE路径:选择models/vae/下的ae.sft,可在上面Flux depth模型下载链接里获取。

- 服务器地址:默认填写127.0.0.1:8188

图像控制

- FLux引导:控制depth图像的引导强度,建议填写20-35之间。

- 采样步数:FLux生图的步数。值越大细节越丰富,时间越慢。

- 深度图路径:填写深度图路径,(不加文件名),该文件夹建议只放一张深度图。

- 保存路径:出图完成之后除了out文件外另外一个保存的路径。

- 图像前缀:生成图片保存时文件名前缀,

- 图片数量:一次生成多少张图像。

高清放大

- 启用放大:如果勾选,图像在生成之后将会进行一次细节放大修复,建议先生成一次满意的图像,再勾选启用放大执行放大。

- 放大系数:在原始的分辨率上再进行多少倍的放大

- 放大模型 :选择/models/upscale_models文件夹里的放大模型

- 放大种子:不同的种子得到不同的细节修复效果

- 分块宽度:每次修复的宽度

- 分开高度:每次修复的高度

安装方法

将hda下载下来,通过Houdini菜单上的Assets-Install Asset Library进行安装

版权说明

该HDA仅供数字折叠会员使用,如果在其他平台购买或者下载本站不提供任何售后支持以及代码优化。请支持正版。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

THE END

暂无评论内容